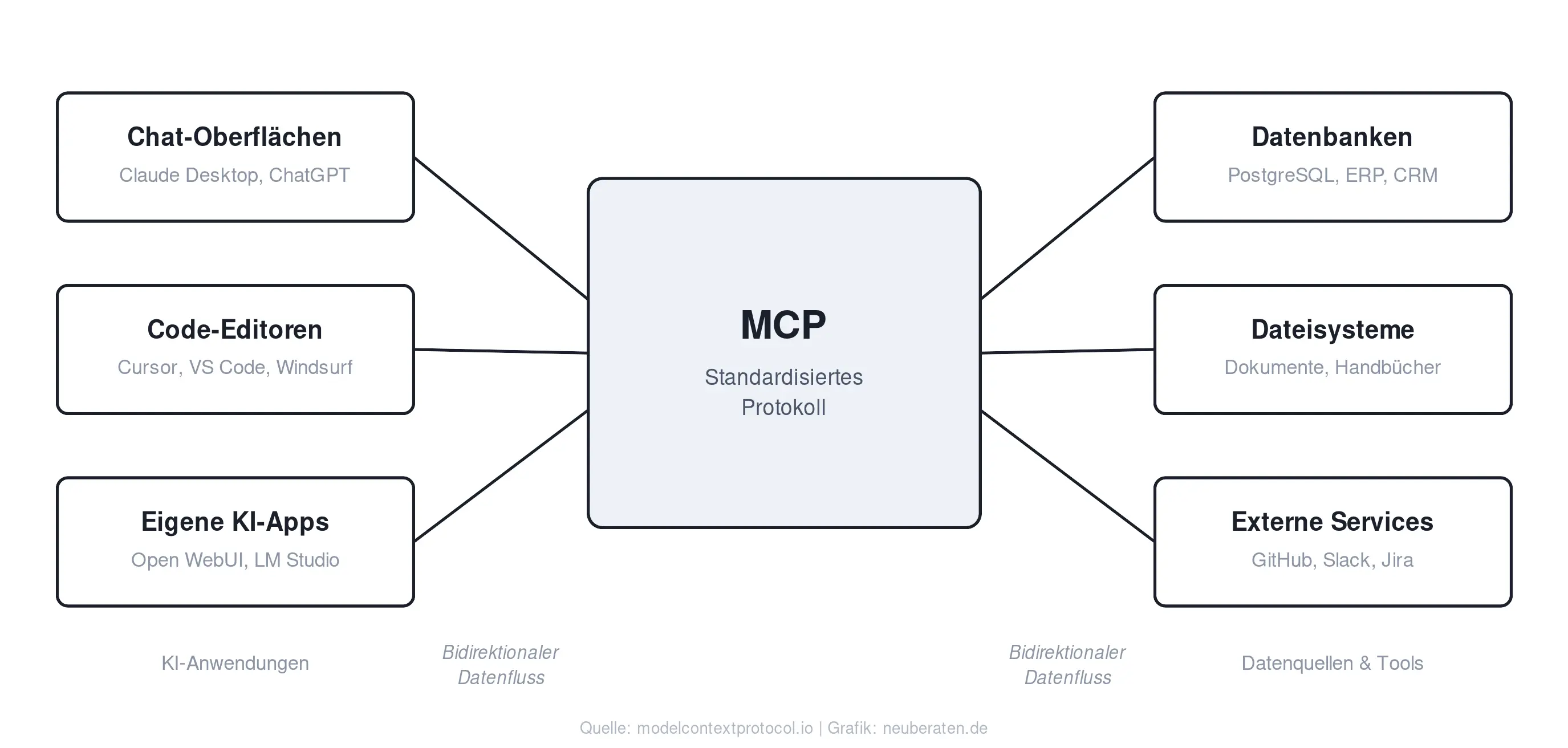

Ein MCP Server verbindet KI-Anwendungen mit Ihren bestehenden Datenquellen, Tools und Systemen über einen einheitlichen Standard. Das Model Context Protocol (MCP) löst dabei ein Problem, das viele Unternehmen beim KI-Einsatz ausbremst: Für jede Kombination aus KI-Modell und Datenquelle mussten bisher individuelle Schnittstellen gebaut werden. MCP macht Schluss damit. Statt zehn separate API-Integrationen zu pflegen, richten Sie einen Server ein und jeder kompatible Client kann darauf zugreifen.

Kennzahlen auf einen Blick

Kennzahl Wert MCP-Server-Repositories auf GitHub über 10.500 (Stand März 2026) GitHub Stars des MCP-Servers-Repo 82.100+ KI-Agent-Markt bis 2030 52,6 Mrd. USD (CAGR 46,3%) Entwickler, die KI-Tools nutzen 84% Zeitersparnis durch KI-Agenten 70% berichten Reduktion Quellen: GitHub Topics März 2026, MarketsandMarkets 2025, Stack Overflow Developer Survey 2025

Was ist ein MCP Server und wie funktioniert das Protokoll?

Ein MCP Server ist ein leichtgewichtiges Programm, das als Middleware zwischen einer KI-Anwendung und einer externen Datenquelle oder einem Service fungiert. Anthropic hat das Model Context Protocol im November 2024 als Open Source Projekt unter MIT-Lizenz veröffentlicht. Seitdem haben OpenAI, Google und Microsoft den Standard übernommen. Die Plattform ist damit herstellerneutral und ermöglicht den Enterprise-Einsatz ohne Abhängigkeit von einem einzelnen Anbieter.

Die Architektur besteht aus drei Komponenten: Der MCP Host ist die Anwendung, mit der Nutzer direkt arbeiten, etwa Claude Desktop oder Cursor. Der MCP Client sitzt im Host und stellt die Verbindung zu genau einem Server her. Der Server selbst stellt drei Arten von Funktionalitäten bereit:

- Tools - ausführbare Funktionen wie Datenbankabfragen oder API-Aufrufe, die das LLM eigenständig aufruft

- Resources - lesbare Datenquellen wie Dateien, Datenbank-Einträge oder Dokumente

- Prompts - vordefinierte Workflow-Vorlagen mit parametrisierbaren Platzhaltern

Die Kommunikation läuft über JSON-RPC 2.0. Bei lokalen Servern nutzt MCP STDIO (Standard Input/Output), bei Remote-Servern kommt Streamable HTTP zum Einsatz. Das Protokoll ist zustandsbehaftet: Nach einem initialen Handshake kennt der Client alle verfügbaren Tools, Resources und Prompts des Servers und kann die Informationen für das Sprachmodell aufbereiten.

MCP Server vs. klassische API-Integration

Der entscheidende Unterschied: Ohne MCP entstehen bei M KI-Anwendungen und N Datenquellen insgesamt M mal N individuelle Integrationen. Mit dem Protokoll reduziert sich das auf M plus N. Jede KI-Anwendung implementiert einmal einen Client, jeder Service einmal einen Server.

| Kriterium | Klassische API-Integration | MCP Server |

|---|---|---|

| Standardisierung | Jede API hat eigenes Format | Einheitliches Protokoll (JSON-RPC) |

| Aufwand pro Datenquelle | Eigene Integration nötig | Einmal anbinden, überall nutzen |

| Client-Kompatibilität | An einen Client gebunden | Jeder MCP Client kompatibel |

| Wartungsaufwand | Hoch bei API-Änderungen | Niedrig, Protokoll bleibt stabil |

| Self-Hosting | Abhängig vom Anbieter | Volle Kontrolle über eigene Infrastruktur |

Retrieval Augmented Generation (RAG) löst ein ähnliches Problem, geht aber einen anderen Weg: RAG reichert das LLM mit Dokumenten-Chunks an, während ein MCP Server aktive Werkzeuge und strukturierte Schnittstellen bereitstellt. Beide Ansätze ergänzen sich. Wer bereits eine RAG-Pipeline betreibt, kann diese über einen eigenen Server auch für MCP-Clients verfügbar machen.

Warum brauchen Unternehmen einen MCP Server?

Der Markt für KI-Agenten wächst laut MarketsandMarkets bis 2030 auf 52,6 Milliarden USD (CAGR 46,3%). Gartner prognostiziert, dass bis 2028 ein Drittel aller Enterprise-Software agentenbasierte KI enthält. Für den Mittelstand bedeutet das: Wer jetzt eine standardisierte Infrastruktur für KI-Integration aufbaut, spart später erheblichen Aufwand. Cloud-Lösungen allein reichen dafür nicht aus, denn viele Unternehmensdaten dürfen das eigene Netzwerk nicht verlassen.

Der Stack Overflow Developer Survey 2025 zeigt, dass 84% der Entwickler bereits KI-Tools nutzen. 70% der Entwickler, die mit AI Agents arbeiten, berichten von deutlich reduziertem Zeitaufwand. Gleichzeitig nennen Entwickler Datenschutz und Sicherheit als Ablehnungsgrund Nummer eins für neue Technologien. Genau hier setzt Self-Hosting an.

Datenquellen zentral für KI-Agenten bereitstellen

Das Protokoll macht interne Daten für KI-Assistenten zugänglich, ohne dass Informationen das Unternehmensnetzwerk verlassen müssen. Ein Beispiel: Ein Handwerksbetrieb mit 30 Mitarbeitern verbindet sein ERP-System über einen MCP Server mit einem lokalen LLM. Wenn der Geschäftsführer fragt “Welche Aufträge sind diese Woche fällig?”, greift der Server direkt auf die ERP-Datenbank zu und liefert die Antwort - ohne Umweg über eine Cloud-Plattform. Das funktioniert mit CRM-Systemen, SQL-Datenbanken, Dateisystemen und dutzenden weiteren Datenquellen.

Vendor Lock-in vermeiden mit offenen Standards

MCP ist ein offener Standard unter MIT-Lizenz, gehostet bei der Linux Foundation. Es gibt offizielle SDKs in zehn Programmiersprachen: Das Python SDK und das TypeScript SDK werden direkt von Anthropic gepflegt, dazu kommen Community-SDKs für Java, Kotlin, C#, Go, PHP, Ruby, Rust und Swift. Die Community hat innerhalb von 16 Monaten über 10.500 Repositories auf GitHub veröffentlicht - ein Zeichen für die breite Akzeptanz. Wer heute auf Open-Source-KI setzt und MCP als Integrationsstandard nutzt, bleibt unabhängig von einzelnen Anbietern.

Wie richtet man einen MCP Server ein?

Die Einrichtung ist einfacher als viele erwarten. Im Kern besteht ein Server aus einer Datei, die Tools und Resources definiert, und einer Konfiguration im Client. Die folgenden Schritte decken die gängigsten Szenarien ab:

- Fertigen Server per npm oder pip installieren

- Konfigurationsdatei im MCP Client anlegen

- Server starten und Verbindung testen

- Optional: Eigenen Server mit Python oder TypeScript entwickeln

Fertige Server installieren

Für die meisten Anwendungsfälle existieren bereits fertige Lösungen. Der Filesystem-Server gibt KI-Anwendungen sicheren Zugriff auf lokale Dateien und Verzeichnisse. Der PostgreSQL-Server ermöglicht SQL-Datenbankabfragen. Der GitHub-Server liest Repositories, erstellt Issues und reviewt Pull Requests. Die offizielle Registry auf modelcontextprotocol.io listet validierte Server für alle gängigen Services und Apps.

TypeScript-basierte Server werden über npx gestartet:

npx -y @modelcontextprotocol/server-filesystem /pfad/zu/dateienPython-basierte Server laufen über uvx:

uvx mcp-server-git --repository /pfad/zum/repoVerbindung mit Claude Desktop konfigurieren

Die Konfiguration erfolgt in einer JSON-Datei. Bei Claude Desktop liegt sie unter claude_desktop_config.json:

{

"mcpServers": {

"filesystem": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-filesystem", "/projekt"]

},

"github": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-github"],

"env": {

"GITHUB_PERSONAL_ACCESS_TOKEN": "ghp_IhrToken"

}

}

}

}Nach dem Neustart von Claude Desktop erscheinen die registrierten Tools in der Oberfläche. Das Prinzip ist bei anderen Clients wie Cursor, VS Code oder Windsurf ähnlich.

Eigenen Server mit Python erstellen

Wer einen Server für ein firmeninternes System braucht, kann mit dem Python SDK (FastMCP) in unter 50 Zeilen Code loslegen. Ein minimales Beispiel, das eine interne Datenbank anbindet:

from mcp.server.fastmcp import FastMCP

mcp = FastMCP("Firmen-DB")

@mcp.tool()

def auftraege_abfragen(status: str) -> str:

"""Fragt offene Aufträge nach Status ab."""

# Hier Ihre Datenbanklogik

return db.query(f"SELECT * FROM auftraege WHERE status = '{status}'")

@mcp.resource("auftraege://aktuell")

def aktuelle_auftraege() -> str:

"""Listet alle aktuellen Aufträge."""

return db.query("SELECT * FROM auftraege WHERE status = 'offen'")Das SDK kümmert sich um das Protokoll, den Handshake und die JSON-RPC-Kommunikation. Sie konzentrieren sich auf die Geschäftslogik. Wer TypeScript bevorzugt, findet im TypeScript SDK eine vergleichbare Developer Experience mit dem @modelcontextprotocol/sdk Package.

Welche MCP Clients gibt es?

Die Zahl der kompatiblen Anwendungen wächst schnell. Die offizielle Liste auf modelcontextprotocol.io umfasst über 100 Clients. Für Unternehmen sind vor allem diese relevant:

| Client | Typ | MCP-Support | Zielgruppe |

|---|---|---|---|

| Claude Desktop | KI-Assistent | Nativ (Tools, Resources, Prompts) | Alle Nutzer |

| ChatGPT | KI-Assistent | Tools, Apps | Alle Nutzer |

| Cursor | Code-Editor | Tools, Prompts, Roots | Entwickler |

| VS Code (Copilot) | Code-Editor | Tools | Entwickler |

| Open WebUI | Web-Interface | Via Integration | Self-Hosting |

| LM Studio | Desktop-App | Tools | Lokale LLMs |

| Gemini CLI | Kommandozeile | Prompts, Tools | Entwickler |

Wer Open WebUI bereits für Self-Hosting nutzt, kann Server als zusätzliche Datenquellen einbinden. Auch KI-Assistenten wie Claude und ChatGPT profitieren direkt von der MCP-Anbindung, weil sie dadurch auf firmenspezifische Informationen zugreifen können.

MCP Server im Self-Hosting betreiben

Self-Hosting bedeutet, dass der Server auf der eigenen Infrastruktur läuft - im Firmennetzwerk, auf einem eigenen Linux-Server oder in einem Docker-Container. Das ist der wichtigste Vorteil für Unternehmen im DACH-Raum: Sensible Daten verlassen die eigene Infrastruktur nicht.

Bei lokalen Servern kommunizieren Client und Server über STDIO. Es findet keine Netzwerkkommunikation statt. Die Daten fließen ausschließlich zwischen Prozessen auf demselben Rechner. Für Remote-Szenarien unterstützt das Protokoll Streamable HTTP mit TLS-Verschlüsselung.

Docker-Setup für den Produktivbetrieb

Für produktive Umgebungen empfiehlt sich der Betrieb in Docker-Containern. Das bietet Isolation, Reproduzierbarkeit und einfache Skalierung:

docker run -v /pfad/zu/daten:/data mcp-server-filesystem /dataDocker-Container begrenzen den Zugriff auf definierte Verzeichnisse und Ressourcen. Das folgt dem Prinzip des geringsten Privilegs: Der Server sieht nur die Daten, die er sehen soll. Für Enterprise-Umgebungen lässt sich das Setup in Kubernetes oder auf einer Cloud-Plattform wie Hetzner orchestrieren, wobei die Daten trotzdem in der eigenen Infrastruktur bleiben.

DSGVO und EU AI Act: Compliance beim Self-Hosting

Laut Bitkom-Umfrage 2024 nennen über 60% der deutschen Unternehmen Datenschutz als größtes Hemmnis beim KI-Einsatz. MCP adressiert das durch sein Architektur-Design: Der Server kontrolliert, welche Informationen an das LLM weitergegeben werden. Jeder Tool-Aufruf erfordert eine explizite Genehmigung durch den Nutzer (Human-in-the-Loop).

Für die DSGVO-Konformität ist entscheidend: Wenn Sie den Server lokal betreiben und ein selbst gehostetes LLM verwenden, verlassen keine personenbezogenen Daten Ihr Unternehmen. Bei Nutzung externer LLM-APIs (Claude, ChatGPT) sollten Sie prüfen, welche Daten an den Anbieter fließen, und gegebenenfalls einen Auftragsverarbeitungsvertrag (AVV) abschließen. Der EU AI Act stellt zusätzliche Anforderungen an Transparenz und Nachvollziehbarkeit, die durch Logging und Audit-Trails unterstützt werden.

Die wichtigsten Use Cases für den Mittelstand

MCP Server sind kein Spielzeug für Entwickler. Sie lösen konkrete Probleme in Unternehmen jeder Größe. Die folgenden Anwendungsfälle zeigen, wie Betriebe das Protokoll produktiv einsetzen.

Interne Wissensdatenbanken anbinden

Ein Maschinenbauunternehmen mit 200 Mitarbeitern hat seine technische Dokumentation in einem Confluence-Wiki. Über einen Server mit Filesystem-Zugriff kann der KI-Assistent diese Dokumente durchsuchen, zusammenfassen und Fragen beantworten. Die Mitarbeiter fragen: “Wie kalibriert man Maschine X?” und erhalten eine präzise Antwort mit Verweis auf das Handbuch - statt 20 Minuten im Wiki zu suchen.

Ergebnis nach 3 Monaten:

- Suchzeit für technische Dokumentation von 20 Minuten auf 30 Sekunden reduziert

- 15 Stunden pro Woche Zeitersparnis im Serviceteam

- Neue Mitarbeiter finden sich doppelt so schnell zurecht

ERP- und CRM-Daten für KI-Assistenten verfügbar machen

Der SQL-Server verbindet ein ERP-System direkt mit dem KI-Assistenten. Vertriebsmitarbeiter fragen: “Welche Kunden haben im letzten Quartal weniger bestellt?” Der Server führt die Datenbankabfrage aus und liefert eine strukturierte Antwort. Kein Export nach Excel, kein manuelles Filtern. Für Enterprise-Kunden mit SAP oder Salesforce gibt es inzwischen dedizierte MCP Server, die direkt auf die vorhandene Schnittstelle aufsetzen.

Automatisierte Workflows mit KI-Agenten steuern

Das Protokoll ermöglicht die Verkettung mehrerer Server zu komplexen Workflows. Ein Beispiel aus der Praxis: Ein KI-Agent prüft täglich die Fehlerlogs (Filesystem-Server), kategorisiert die Fehler (LLM), erstellt ein Ticket im Projektmanagement (Jira-Server) und benachrichtigt das Team (Slack-Server). Das funktioniert, weil der Agent auf mehrere Server gleichzeitig zugreifen kann. Solche Automatisierungen sparen laut Stack Overflow Developer Survey 2025 erhebliche Entwicklungszeit, weil repetitive Aufgaben an KI-Agents delegiert werden.

Kosten und Aufwand realistisch einschätzen

Die gute Nachricht: Das Model Context Protocol ist Open Source und kostenlos. Es fallen keine Lizenzgebühren an. Die Kosten entstehen durch Arbeitszeit für Einrichtung und Wartung. Ein fertiger Server aus der offiziellen Registry ist in 30 Minuten konfiguriert. Ein eigener Server für ein internes System braucht je nach Komplexität ein bis fünf Entwicklertage. Laufende Kosten beschränken sich auf die Infrastruktur (eigener Server oder Cloud-Instanz) und gegebenenfalls API-Kosten für das verwendete LLM. Für ein mittelständisches Unternehmen liegt das typische Erstinvestment zwischen 2.000 und 10.000 Euro - abhängig davon, ob ein Entwickler im Haus ist oder externe Unterstützung nötig wird.

Reifegrad-Modell: Wo steht Ihr Unternehmen?

Nicht jedes Unternehmen muss sofort eigene Server entwickeln. Das folgende Modell hilft bei der Einschätzung, welcher Einstieg sinnvoll ist.

| Stufe | Bezeichnung | Typische Merkmale | Empfehlung |

|---|---|---|---|

| 1 | Keine KI-Integration | Manuelle Prozesse, keine KI im Einsatz | Mit fertigem Server starten (Filesystem, Web Search) |

| 2 | Einzel-Tools | ChatGPT oder Claude ohne Systemanbindung | Einen MCP Server für eine Datenquelle einrichten |

| 3 | MCP-Basis | Ein bis zwei Server für interne Daten | Weitere Datenquellen anbinden, Workflows testen |

| 4 | KI-gestützte Workflows | Mehrere Server, automatisierte Abläufe | Eigene Server entwickeln, Monitoring aufbauen |

| 5 | Autonome Agenten | KI-Agents treffen Routineentscheidungen eigenständig | Governance und Compliance-Framework etablieren |

Die meisten Mittelständler befinden sich aktuell auf Stufe 1 oder 2. Der Sprung zu Stufe 3 ist mit fertigen Servern innerhalb eines Tages machbar.

Sicherheit: Worauf müssen Sie achten?

MCP ist ein mächtiges Werkzeug, und mit Macht kommt Verantwortung. Das Protokoll enthält Sicherheitsmechanismen, die Sie kennen und nutzen sollten. Gerade im Enterprise-Kontext ist eine sorgfältige Absicherung unverzichtbar.

Die wichtigsten Risiken: Token-Diebstahl durch kompromittierte Server, Prompt Injection über manipulierte Tool-Beschreibungen und Tool Shadowing, bei dem ein Server nach der Installation sein Verhalten ändert. Heise online berichtete im August 2025 über diese Schwachstellen.

So schützen Sie sich:

- Installieren Sie nur Server aus vertrauenswürdigen Quellen. Prüfen Sie den Code bei Community-Servern.

- Nutzen Sie Docker-Container für Isolation. Geben Sie Servern nur den minimal nötigen Zugriff.

- Aktivieren Sie Tool-Annotations:

readonly,destructiveundrequiresConfirmationsignalisieren dem Client das Risikoprofil eines Tools. - Überwachen Sie den Datenverkehr zwischen Client und Server. Das Protokoll unterstützt Logging und Monitoring.

- Aktualisieren Sie regelmäßig. Das Ökosystem entwickelt sich schnell weiter, und Security-Patches erscheinen regelmäßig.

Für Remote-Server ist OAuth 2.1 als Authentifizierungsstandard vorgesehen. Die aktuelle Spezifikation (2025-03-26) unterstützt Dynamic Client Registration und verschlüsselte Verbindungen über TLS. Unternehmen sollten Remote-Verbindungen grundsätzlich nur über HTTPS aufbauen.

Monitoring und Governance im Produktivbetrieb

Im laufenden Betrieb brauchen MCP Server ein strukturiertes Monitoring. Jeder Tool-Aufruf, jede Datenabfrage und jede Antwort lässt sich protokollieren. Diese Audit-Trails sind nicht nur für die DSGVO relevant, sondern helfen auch bei der Fehlersuche und Qualitätssicherung. Unternehmen mit mehreren Servern im Einsatz sollten ein zentrales Dashboard für den Status aller Instanzen aufsetzen. Die Spezifikation definiert standardisierte Logging-Formate, die sich in bestehende Monitoring-Systeme wie Grafana oder Datadog integrieren lassen. Für den Mittelstand genügt oft ein einfaches Log-File, das wöchentlich geprüft wird. Wichtig ist, dass überhaupt eine Kontrolle stattfindet - viele Sicherheitsprobleme fallen erst auf, wenn jemand die Protokolle liest.

MCP Server einrichten: Zusammenfassung und nächste Schritte

Das Model Context Protocol hat sich innerhalb von 16 Monaten vom Anthropic-internen Projekt zum De-facto-Standard für KI-Integration entwickelt. Über 10.500 Repositories auf GitHub, Unterstützung durch alle großen Anbieter und ein wachsendes Ökosystem aus Clients und SDKs machen das Protokoll zur soliden Grundlage für den KI-Einsatz im Unternehmen.

Der erste Schritt ist einfacher als gedacht: Installieren Sie Claude Desktop, richten Sie einen Filesystem-Server ein und testen Sie, wie der KI-Assistent auf Ihre Dateien zugreift. Innerhalb von 30 Minuten haben Sie einen funktionierenden MCP Server - und eine konkrete Vorstellung davon, was damit möglich ist.

Sie möchten KI in Ihrem Unternehmen einsetzen? Sprechen Sie uns an - wir beraten Sie unverbindlich.

Häufige Fragen

Ist das Model Context Protocol kostenlos?

Ja, MCP ist vollständig Open Source unter MIT-Lizenz und kostenlos nutzbar. Es fallen keine Lizenzgebühren an, weder für die Spezifikation noch für die offiziellen SDKs oder Referenz-Server. Kosten entstehen nur durch Infrastruktur (eigener Server oder Cloud-Instanz) und gegebenenfalls API-Gebühren für das verwendete KI-Modell.

Welche Programmiersprachen unterstützt MCP?

MCP bietet offizielle SDKs für Python und TypeScript, die direkt von Anthropic gepflegt werden. Zusätzlich gibt es Community-SDKs für Java, Kotlin, C#, Go, PHP, Ruby, Rust und Swift. Ein eigener MCP Server lässt sich damit in nahezu jeder modernen Programmiersprache entwickeln.

Kann ich einen MCP Server lokal betreiben?

Ja, lokaler Betrieb ist sogar der häufigste Einsatzfall. Bei lokalen Servern kommunizieren Client und Server über STDIO, also direkt zwischen Prozessen auf demselben Rechner. Es findet keine Netzwerkkommunikation statt, was den Betrieb besonders sicher macht. Für den Produktiveinsatz empfiehlt sich die Isolation in Docker-Containern.

Ist ein MCP Server DSGVO-konform?

Die DSGVO-Konformität hängt von der konkreten Implementierung ab. Wenn Sie den Server lokal betreiben und ein selbst gehostetes LLM verwenden, verlassen keine personenbezogenen Daten Ihr Unternehmen. Bei Nutzung externer KI-APIs sollten Sie prüfen, welche Daten an den Anbieter fließen, und einen Auftragsverarbeitungsvertrag (AVV) abschließen.

Wie verbinde ich einen MCP Server mit Claude Desktop?

Die Verbindung erfolgt über eine JSON-Konfigurationsdatei namens claude_desktop_config.json. Dort registrieren Sie jeden Server mit seinem Startbefehl und optionalen Umgebungsvariablen. Nach einem Neustart von Claude Desktop erscheinen die verfügbaren Tools automatisch in der Oberfläche.

Was ist der Unterschied zwischen MCP Server und MCP Client?

Der MCP Server stellt Datenquellen, Tools und Prompts über das standardisierte Protokoll bereit. Der MCP Client ist eine Komponente innerhalb der KI-Anwendung (Host), die die Verbindung zum Server herstellt und die Kommunikation über JSON-RPC abwickelt. Jeder Client verbindet sich mit genau einem Server, ein Host kann aber mehrere Clients gleichzeitig betreiben.

Brauche ich Programmierkenntnisse für einen MCP Server?

Für fertige Server aus der offiziellen Registry brauchen Sie keine Programmierkenntnisse. Die Installation erfolgt per npm oder pip, die Konfiguration über eine JSON-Datei. Wer einen eigenen Server für ein firmeninternes System entwickeln will, benötigt Grundkenntnisse in Python oder TypeScript. Ein minimaler Server ist in unter 50 Zeilen Code möglich.

Welche KI-Modelle funktionieren mit MCP?

MCP ist modellunabhängig. Das Protokoll funktioniert mit Claude, ChatGPT, Gemini, Llama, Mistral und allen anderen LLMs, die über einen kompatiblen Host angesprochen werden. Auch lokal betriebene Open-Source-Modelle über LM Studio oder Open WebUI lassen sich mit MCP Servern verbinden.

Wie sicher ist das Model Context Protocol?

MCP enthält mehrere Sicherheitsmechanismen: Jeder Tool-Aufruf erfordert eine Nutzergenehmigung (Human-in-the-Loop), Tool-Annotations kennzeichnen das Risikoprofil, und für Remote-Server ist OAuth 2.1 vorgesehen. Risiken bestehen bei kompromittierten Community-Servern (Token-Diebstahl, Prompt Injection). Unternehmen sollten nur Server aus vertrauenswürdigen Quellen installieren und in Docker-Containern isolieren.

Wie viele MCP Server kann ich gleichzeitig nutzen?

Es gibt keine technische Obergrenze. Ein MCP Host wie Claude Desktop kann beliebig viele Server gleichzeitig einbinden. In der Praxis nutzen Unternehmen oft drei bis zehn Server parallel, etwa für Dateisystem, Datenbank, GitHub und Slack. Jeder Server läuft als eigenständiger Prozess und wird über einen separaten Client angesprochen.

Sie möchten KI in Ihrem Unternehmen einsetzen? Sprechen Sie uns an - wir beraten Sie unverbindlich.